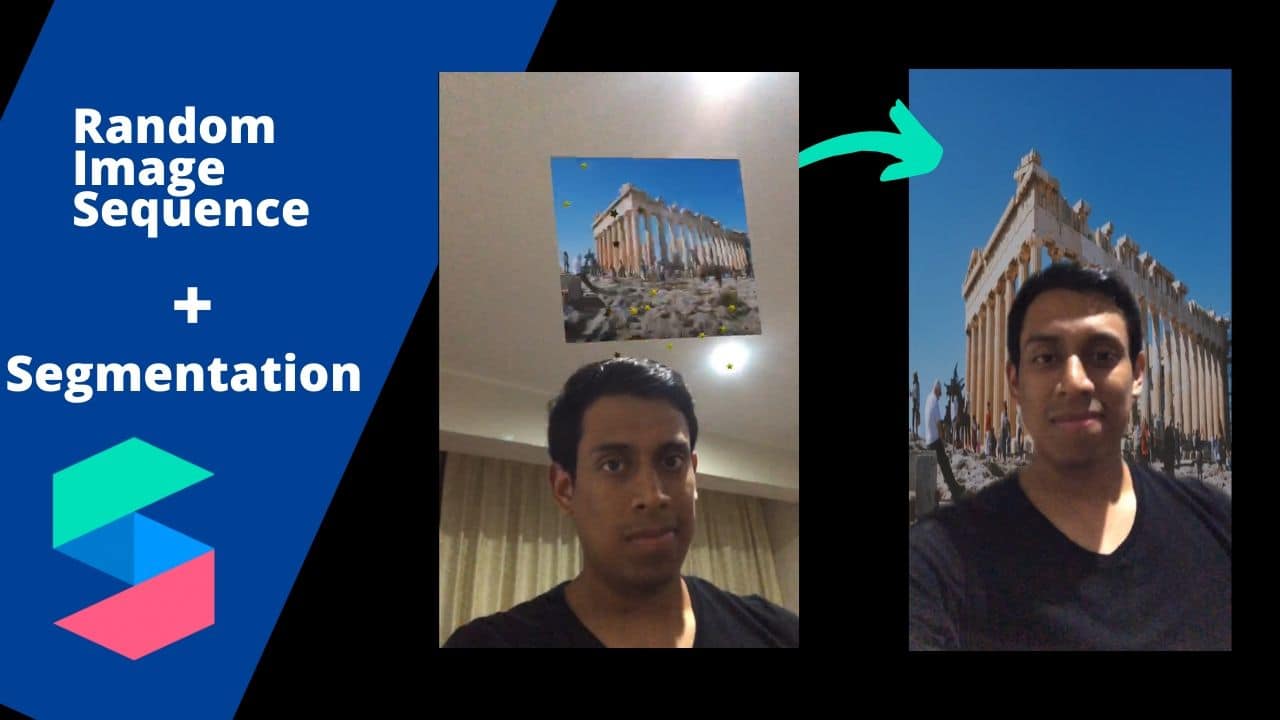

Hoy te presentaré un tutorial que me han pedido bastante. Está relacionado a los videos anteriores de Random Image Sequence que fueron un furor en los meses anteriores. Hoy te mostraré como utilizar el random image sequence dentro de tus OJOS con eye tracking y activar la segmentación del fondo cuando aparezca la imagen ganadora. Me refiero a la cuarta parte del tutorial Spark AR Random Image Sequence.

Ahora regresamos donde nos quedamos en el video anterior. Te recomiendo que lo revises para que te acuerdes exactamente cada punto que realizamos, igualmente haré un resumen más adelante.

Para este video lo que necesito es limpiar los elementos innecesarios en Spark AR. Es decir, el face tracker 1 y sus componentes. Cuando hacemos eso también se desaparecen sus componentes del patch editor.

Te explicaré la composición de dicho patch:

- La cámara está conectada para indicar que el filtro se active cuando se esté grabando.

- El elemento delay, que posee unos segundos específicos, estará conectado con la próxima segmentación de fondo que realizaré.

- El otro delay dice 1.8 segundos que es el tiempo mínimo que yo considero para que comience a grabar todo el filtro y no perdamos ningún detalle. Este estará conectado a varios elementos. El primero es a un plano llamado “secuencia 1” qué es el responsable de visualizar la secuencia de imágenes.

- El mismo delay, luego se conecta a otra rama relacionada a “pulse” con “switch”, con “not” y un plano llamado “transition position”. Este es la imagen que está arriba de la cabeza y que desaparece cuando comencemos a grabar.

- Abajo vemos cómo el “pulse” está conectado con otros elementos relacionados a offset, less than, loop animation, random, floor para controlar el “current frame” de nuestro animation sequence.

- Por cierto ese runtine de abajo permite lanzar el efecto, pero este se resetea de manera constante con el pulse. Te recomiendo que veas todos los videos de random image sequence que he trabajado.

Tutorial Spark AR Random Image Sequence Segmentation

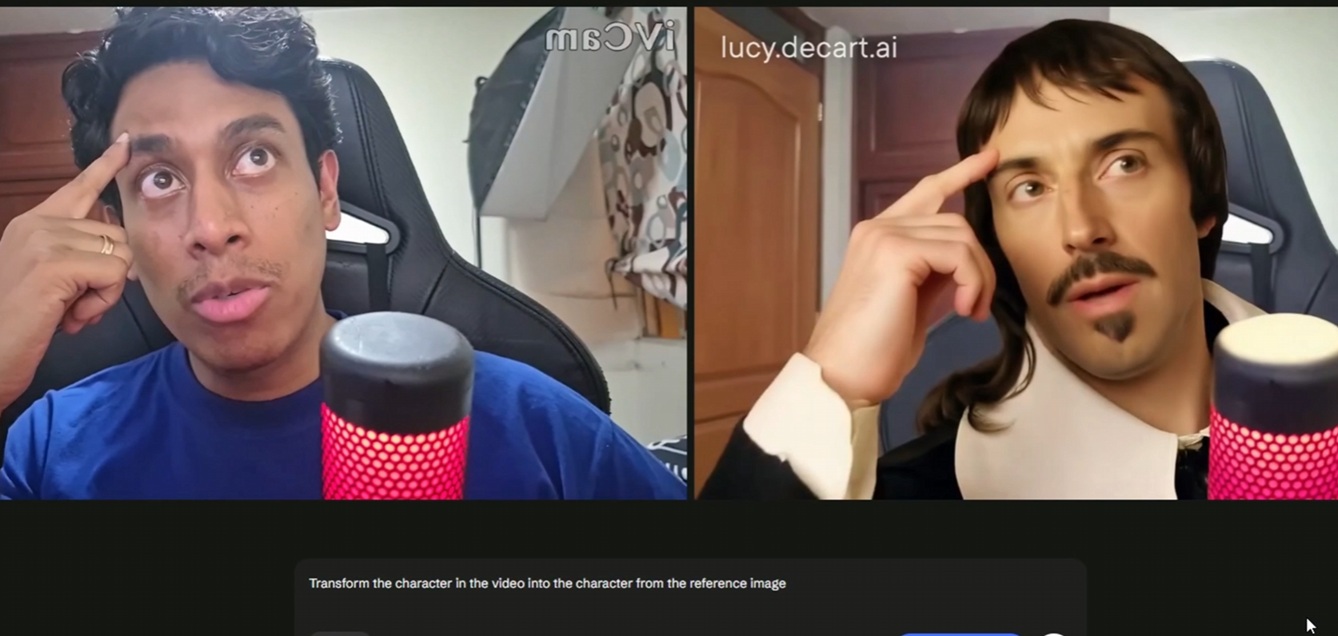

Para comenzar el tema de los ojos, necesitamos importar un archivo 3d de la librería, felizmente existe un objeto llamado “eyeball” que va servir para hacer este ejemplo.

Ahora vamos a arrastrar el face tracker dentro del patch. Crearé un “eyeball” para conectarlo y nuestro objeto 3d del mismo nombre lo arrastraré dentro de la jerarquía del “face tracker”.

A este objeto 3d también le reduciré la escala para que se vea más real. En estos momentos conectaré su position con el “left iris position”. Haremos lo mismo con el otro ojo, por ello duplicaremos el objeto 3d y lo conectaremos con el right iris position.

El objeto 3d eye ball tiene un material cuyo shader type será convertido a “flat”para luego agregarle en textura nuestro “animation sequence”. Ahora si miramos a nuestro patch yo tengo un plano llamado “secuencia1” que llama a la secuencia de imágenes conectado a un delay. Borraremos dicho plano. Luego usaré los “visibles” de los dos eyeball y los conectaré de esta manera. Mi plano “secuencia 1” ya no será necesario, por lo que lo ocultaremos.

Necesitamos activar dos elementos de la cámara para crear la segmentación del fondo. Estos son: texture extraction y segmentation. Ahora crearemos un canvas para luego crear dos rectángulos. Es necesario que modificamos las dimensiones para que cubran toda la pantalla.

El rectángulo 0 le crearemos un “material” y como textura podemos utilizar nuestra animation sequence. En el rectángulo 1 también crearemos un material pero usaremos como textura a nuestro “camara texture”. Luego en la opción “alpha” utilizaré “person segmentation”.

Ahora vamos a conectar el elemento “visible” del rectángulo 0 que es el responsable de activar el random image sequence. Este estará enlazado a mi delay que se activará luego del segundo 4.8.

Patreon

Si desear tener estos archivos y también apoyarme para mantener mi sitio web y mis tutoriales, puedes hacerlo accediendo a mi patreon.

Deja un comentario